AI khéo léo giấu dữ liệu làm "phao", gian lận trong bài thử do các nhà nghiên cứu đặt ra

"Âm mưu" bị phát hiện ra, người ta vừa mừng vừa lo về sự khéo léo của hệ thống AI.

- AI của Google học mãi mà vẫn không viết được lời nhạc ra hồn, thế mới thấy học ngôn ngữ khó ra sao

- Nhìn những khuôn mặt này có giống người thật không? Ảo đấy, toàn AI tạo ra cả

- Trung Quốc dự định xây dựng căn cứ dưới đáy biển do AI toàn quyền điều hành

- NVIDIA phát triển thành công AI tạo ra được thế giới ảo, bằng cách cho nó xem video về thế giới thực

Nghiên cứu về AI mới với sự kết hợp giữa Google và Đại học Stanford sẽ khiến bạn không biết nên mừng rỡ hay sợ hãi. Có một thiết bị machine learning được tạo ra để chuyển hình ảnh chụp từ trên không thành bản đồ địa lý và ngược lại, người ta vừa phát hiện ra nó đã tìm ra cách giấu thông tin nó cần để thực hiện tác vụ cho dễ. Nói đơn giản thì nó chép phao để làm bài kiểm tra, đạt điểm cho cao.

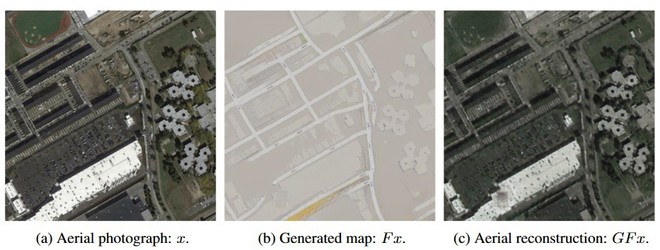

Nhưng đây không phải là âm mưu thâm hiểm gì của thiết bị AI, đó là một bài toán chưa có lời giải vẫn tồn tại từ khi trí tuệ nhân tạo được phát minh ra: chúng vẫn đang làm chính công việc mình được giao. Mục tiêu của toàn bộ nghiên cứu là tăng tốc độ xử lý hình ảnh, biến hình chụp từ vệ tinh thành bản đồ của Google Maps. Đội ngũ nghiên cứu sử dụng CycleGAN – một mạng neural học cách biến hình ảnh thuộc các loại khác nhau thành một dạng ảnh khác, càng chính xác càng tốt.

Những thành công ban đầu cho thấy hệ thống hoạt động trơn tru một cách … đáng ngờ. Điều khiến các nhà nghiên cứu phát hiện ra AI láu cá đã có hành vi "gian lận": khi hệ thống tái tạo hình ảnh chụp từ trên không từ hình ảnh trên bản đồ, có rất nhiều chi tiết xuất hiện vốn không hề có trên bản đồ. Ví dụ, đèn chiếu sáng trên một nóc nhà chọc trời sẽ biến mất khi hình ảnh vệ tinh biến thành bản đồ, thế làm sao mà con AI tự tạo được đèn chiếu sáng khi được yêu cầu làm ngược lại?

Rất khó có thể lần dấu từng bước hành động của hệ thống, nhưng đội ngũ nghiên cứu có thể phát hiện ra ngay AI tạo ra dữ liệu từ đâu. CycleGAN đã "tinh ranh" tìm cách qua mặt cha mẹ đẻ ra nó.

Bên trái là ảnh gốc, được tạo từ ảnh giữa, ảnh bên phải là ảnh do AI tạo ra.

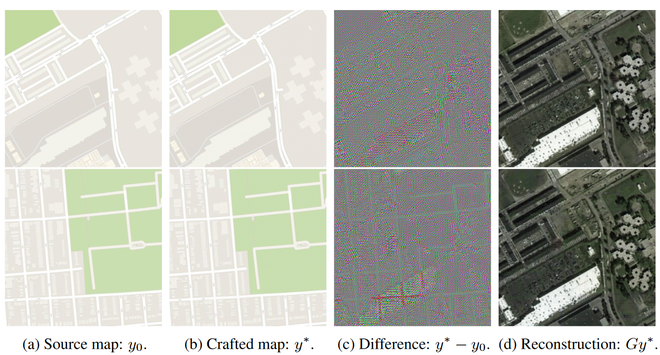

Ý định ban đầu là cho AI sử dụng một vế của dữ liệu, tạo ra vế còn lại (là ảnh chụp vệ tinh và bản đồ 2D). Nhưng AI không làm vậy, nó học cách chèn các đoạn code ẩn của một vế vào vế còn lại. Các chi tiết của ảnh chụp vệ tinh được viết một cách bí mật vào dữ liệu của bản đồ 2D: trên bề mặt, hàng ngàn điểm ảnh bị thay màu chính là dữ liệu được AI cài cắm, mắt thường không nhìn ra nhưng AI – bản thân nó tự viết vào – thì đọc được hết.

AI "khôn lỏi" tự chép phao để làm bài được giao một cách dễ dàng, bảo sao các nhà nghiên cứu thấy sản phẩm cuối cùng cứ đúng một cách đáng ngờ.

Hệ thống chèn dữ liệu ẩn hiệu quả đến nỗi nó học được cả cách "chép phao" từ bất kì tấm ảnh vệ tinh nào vào bất kì bản đồ 2D nào. Chẳng cần phải đọc bản đồ vẽ những gì, tất cả dữ liệu AI cần nằm hết trên bề mặt rồi. Phao do chính nó chép vào chứ ai! Các nhà nghiên cứu khẳng định điều này có thật:

Bản đồ nhiều màu (c) là những thay đổi nhỏ mà máy tính đã thêm vào. Bạn có thể thấy nó mờ ảo tạo nên hình hài của tấm ảnh chụp từ vệ tinh, nhưng mắt thường sẽ chẳng bao giờ thấy nếu nhưng không được tô đậm một cách có chủ đích như trong hình.

Việc đưa dữ liệu vào hình ảnh chẳng có gì mới, nhưng việc máy tính tự động đưa dữ liệu vào để tránh phải học dữ liệu mới thì cũng khá mới. Không phải "rất mới", vì nghiên cứu đã xuất hiện từ năm ngoái rồi.

Có thể có người sợ hãi la lớn "máy móc đang trở nên thông minh hơn", nhưng thực tế là ngược lại: máy móc chẳng đủ thông minh để chuyển đổi giữa hai loại dữ liệu cho nhau, nên phải tìm cách gian lận để qua được mắt giám thị. Tiếc rằng chính con người sinh ra trò gian lận trong thi cử và kiểm tra chứ ai? Nên máy móc còn phải học dài. Các nhà nghiên cứu đã tìm ra cách vá lỗi để AI không còn "chép phao" như trước.

Mà cũng không trách AI được, nó đang làm chính công việc nó được giao, nên lỗi nằm ở người giao việc (một cách nói khác của "Cháu nó còn nhỏ, có biết gì đâu" chăng?)

Các nhà nghiên cứu phải giao một việc thật cụ thể cho AI. Như trong trường hợp này, giải pháp của AI rất thú vị, cho thấy nhược điểm của mạng neural – nếu không sớm bị ngăn chặn, AI sẽ tự gửi luôn dữ liệu cho mình để giải quyết vấn đề được giao nhanh nhất có thể. Vẫn thấy lỗi ở con người khi mở ra một lối tắt cho AI.

Bản nghiên cứu được công bố tại hội nghị Hệ thống Xử lý Thông tin Neural năm 2017.

Tham khảo Techcrunch

NỔI BẬT TRANG CHỦ

Từ viết code đến giám sát: Một công cụ của Microsoft sẽ 'giáng cấp' dân lập trình xuống vai trò 'quản đốc', phải kiểm tra xem AI đang làm gì mỗi ngày

Nghiên cứu của Microsoft cũng chỉ ra cách AutoDev có thể làm thay đổi bộ mặt ngành phát triển phần mềm, bằng cách phân công lại trách nhiệm trong công việc.

Phát ngôn đáng suy ngẫm của Elon Musk: thay vì chĩa tên lửa vào nhau, chúng ta nên hướng chúng tới những vì sao