Microsoft tung hai công cụ mới giúp phát hiện đâu là ảnh hoặc video bị làm giả bằng công nghệ deepfake

Gã khổng lồ phần mềm Microsoft dường như muốn tuyên chuyến với những kẻ xấu lợi dụng công nghệ deepfake để reo rắc sự hoang mang và làm tổn hại đến thanh danh của người khác.

Mới đây Microsoft đã công bố hai công cụ mới giúp xác định hình ảnh và video bị làm giả. Được biết cả hai hệ thống đều vận dụng sức mạnh của trí tuệ nhân tạo.

Hệ thống đầu tiên sử dụng siêu dữ liệu và hệ thống thứ hai dựa vào chương trình "Video Authenticator" để phân tích ảnh, video, từ đó chỉ ra những điểm tin cậy giúp bạn biết liệu một bức ảnh hoặc video đó có bị làm giả hay không.

Hệ thống siêu dữ liệu mà Microsoft gần như tương tự với hệ thống "Authenticity" sắp ra mắt của Adobe (một chương trình dùng để thêm một số thẻ nhất định vào hình ảnh và giúp bạn biết liệu bạn có đang xem bản gốc hoặc bản đã qua chỉnh sửa hay không).

Nhưng thú vị hơn, chương trình "Video Authenticator" của Microsoft thực sự có thể phân tích và xác định được cả với ảnh tĩnh lẫn video.

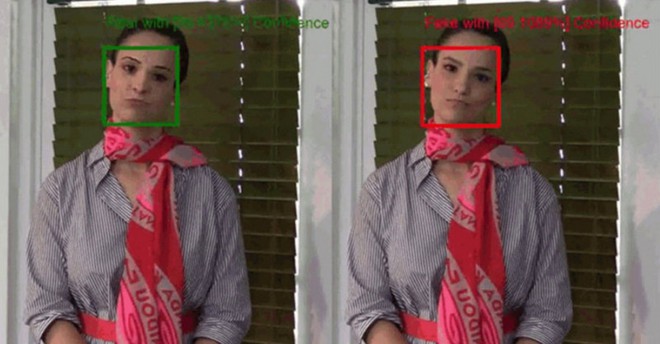

Theo Microsoft: "Video Authenticator có thể phân tích ảnh tĩnh hoặc video, từ đó cung cấp tỷ lệ phần trăm sai khác hoặc điểm tin cậy để biết liệu nội dung đó có đang bị làm giả hay không. Trong trường hợp video, nó có thể cung cấp tỷ lệ phần trăm độ trung thực của video ngay trên mỗi khung hình video đang phát. Chương trình hoạt động bằng cách phát hiện ranh giới pha trộn giữa các yếu tố bị làm mờ hoặc greyscale mà mắt người không phát hiện ra được".

Công nghệ này được tạo ra nhằm chống lại deepfake, một dạng lừa đảo ảnh hoặc video sử dụng các thuật toán deep learning. Các nội dung số này thường bị làm giả nhắm mạo danh các nhân vật chính trị hoặc người nổi tiếng. Deepfake đang ngày càng trở nên nguy hiểm hơn vì nó đã đủ khả năng xóa nhòa đi ranh giới giữa thật và giả, khiến người xem dù tinh ý đến mấy cũng khó nhận ra.

Đây chính là điều mà Video Authenticator đang cố gắng giải quyết. Hơn nữa nhờ việc tích hợp bộ dữ liệu mới nhất và sự hỗ trợ của AI nên nó có thể dễ dàng phát hiện ra sự bất thường mà con người không thể nhìn thấy.

Do đây là hệ thống dựa trên deep learning và AI nên nó sẽ không được phát hành công khai để tránh nguy cơ kẻ xấu đào tạo các thuật toán deepfake mới qua mặt Video Authenticator.

Thay vào đó, Microsoft sẽ cung cấp Video Authenticator cho các đối tác thông qua sáng kiến Reality Defender 2020 của AI Foundation.

Tham khảo Petapixel

NỔI BẬT TRANG CHỦ

Người Trung Quốc khoe có được GPU AI xịn nhất của NVIDIA bất chấp lệnh cấm vận của Mỹ

Chưa rõ tại sao những GPU này lại có thể xuất hiện ở Trung Quốc.

Thiết kế mới của iPhone 17 Pro được xác nhận bởi nhiều nguồn uy tín