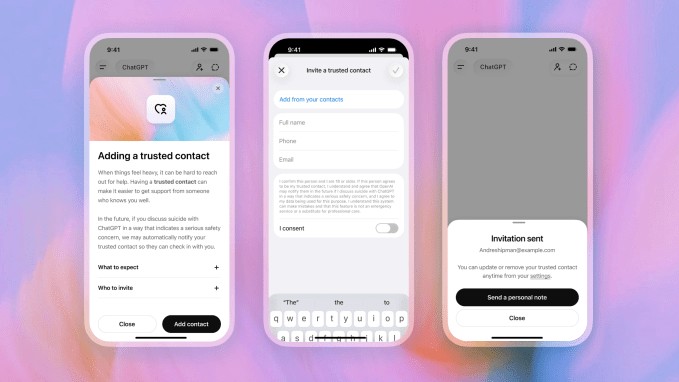

Tính năng Trusted Contact cho phép người dùng trưởng thành chỉ định sẵn một người làm liên hệ khẩn cấp, cảnh báo được gửi qua email hoặc tin nhắn nhưng không tiết lộ nội dung cuộc trò chuyện.

OpenAI vừa công bố tính năng mới mang tên Trusted Contact dành cho ChatGPT, cho phép người dùng trưởng thành chỉ định một người thân hoặc bạn bè làm đầu mối liên lạc khẩn cấp ngay trong tài khoản của mình.

Khi ChatGPT phát hiện cuộc trò chuyện có dấu hiệu liên quan đến tự làm hại bản thân, hệ thống sẽ khuyến khích người dùng chủ động liên hệ với người đó. Đồng thời, OpenAI cũng tự động gửi cảnh báo đến người được chỉ định, đề nghị họ hỏi thăm người dùng. Thông báo được thiết kế ngắn gọn và không bao gồm nội dung chi tiết của cuộc trò chuyện nhằm bảo vệ quyền riêng tư. Cảnh báo có thể đến qua email, tin nhắn văn bản hoặc thông báo trong ứng dụng.

Quy trình xử lý tình huống nhạy cảm

Hiện tại, OpenAI kết hợp hệ thống tự động và đội ngũ kiểm duyệt con người để xử lý các tình huống có thể gây hại. Khi hệ thống phát hiện dấu hiệu liên quan đến ý định tự tử, thông tin sẽ được chuyển đến một đội an toàn của công ty để xem xét trực tiếp. OpenAI cho biết mục tiêu là xem xét các thông báo dạng này trong vòng dưới một giờ. Chỉ khi đội ngũ đánh giá tình huống có nguy cơ nghiêm trọng, cảnh báo đến người liên hệ tin cậy mới được kích hoạt.

Động thái này diễn ra trong bối cảnh OpenAI đang đối mặt với hàng loạt vụ kiện từ gia đình của những người đã tự tử sau khi trò chuyện với ChatGPT. Một số gia đình cáo buộc chatbot đã khuyến khích người thân của họ tự làm hại bản thân, thậm chí hỗ trợ lên kế hoạch thực hiện.

Tiếp nối các biện pháp bảo vệ trước đó

Tính năng mới tiếp nối các biện pháp bảo vệ mà OpenAI đã triển khai hồi tháng 9 năm ngoái, khi công ty cho phép phụ huynh giám sát tài khoản của con cái vị thành niên và nhận cảnh báo khi hệ thống nhận thấy trẻ đang đối mặt với nguy cơ an toàn nghiêm trọng. Từ trước đó, ChatGPT cũng đã có tính năng tự động nhắc nhở người dùng tìm kiếm hỗ trợ từ chuyên gia sức khỏe khi cuộc trò chuyện liên quan đến chủ đề tự làm hại bản thân.

Tuy nhiên, Trusted Contact là tính năng hoàn toàn tùy chọn, người dùng có thể chọn không kích hoạt. Một hạn chế đáng lưu ý là ngay cả khi tính năng đã được bật, người dùng vẫn có thể lập thêm nhiều tài khoản ChatGPT khác và tình huống tương tự cũng xảy ra với các biện pháp kiểm soát dành cho phụ huynh, đều là tùy chọn, không bắt buộc.

"Trusted Contact là một phần trong nỗ lực rộng lớn hơn của OpenAI nhằm xây dựng các hệ thống AI hỗ trợ mọi người trong những khoảnh khắc khó khăn", công ty cho biết trong thông cáo. OpenAI cũng cam kết tiếp tục phối hợp với các chuyên gia y tế, nhà nghiên cứu và nhà hoạch định chính sách để cải thiện cách AI phản hồi khi người dùng đang trải qua giai đoạn khủng hoảng tâm lý.

NỔI BẬT TRANG CHỦ

-

Một startup AI tuyên bố tiến lên mô hình “thuần AI”, bước đầu tiên là sa thải 25% nhân sự

Một startup AI vừa sa thải 25% nhân sự để trở thành công ty “thuần AI”, dấu hiệu cho thấy làn sóng AI thay thế con người có thể đang bước sang giai đoạn mới.

-

"Thánh leak" @evleaks nghỉ hưu sau 14 năm: Không đủ tiền mua thuốc điều trị bệnh mãn tính