DeepSeek tối ưu AI theo cách không ai ngờ: Bỏ qua chuẩn lập trình chung của toàn ngành, áp dụng 'bí kíp' mang tên PTX từ Nvidia

Sự đột phá này đã tạo ra xáo trộn lớn trong thị trường, khi một số nhà đầu tư tin rằng nhu cầu về phần cứng hiệu suất cao cho các mô hình AI mới sẽ giảm xuống, điều này có thể ảnh hưởng đến doanh thu của các công ty như Nvidia

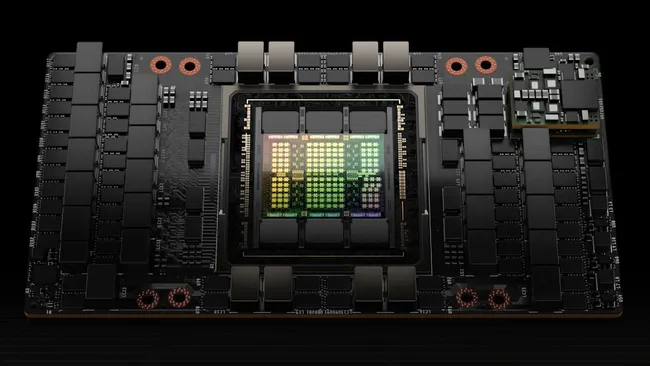

DeepSeek đã gây ấn tượng mạnh trong ngành công nghiệp AI khi huấn luyện mô hình ngôn ngữ Mixture-of-Experts (MoE) với 671 tỷ tham số, sử dụng một cụm máy tính với 2.048 GPU Nvidia H800 trong khoảng thời gian chỉ hai tháng. Điều đặc biệt là hiệu suất của họ đạt gấp 10 lần so với những gã khổng lồ AI như Meta. Thành công này có được nhờ vào việc áp dụng hàng loạt tối ưu hóa chi tiết và việc sử dụng chương trình PTX (Parallel Thread Execution) của Nvidia thay vì chuẩn CUDA thông dụng, theo một phân tích từ Mirae Asset Securities Korea được trích dẫn bởi @Jukanlosreve.

PTX - Công nghệ bí mật của DeepSeek

PTX là một kiến trúc bộ chỉ thị trung gian được thiết kế bởi Nvidia cho các GPU của mình. PTX hoạt động như một cầu nối giữa các ngôn ngữ lập trình GPU cấp cao (như CUDA C/C++ hoặc các ngôn ngữ khác) và mã máy cấp thấp (streaming assembly, hay SASS). PTX được tối ưu hóa cho việc tính toán song song dữ liệu, cho phép thực hiện các tối ưu hóa chi tiết như phân bổ thanh ghi và điều chỉnh mức thread/warp – những thứ mà CUDA (nền tảng và giao diện lập trình ứng dụng tiêu chuẩn của Nvidia, được sử dụng để lập trình các GPU, giúp tăng tốc các tác vụ tính toán nặng) và các ngôn ngữ khác không thể làm được. Khi PTX được chuyển sang SASS, nó được tối ưu hóa cho một thế hệ GPU cụ thể của Nvidia.

Ví dụ, trong quá trình huấn luyện mô hình V3, DeepSeek đã tái cấu hình các GPU H800 của Nvidia: trong số 132 multiprocessors của dòng H800, họ đã dành 20 cho giao tiếp giữa các server, có thể để nén và giải nén dữ liệu nhằm vượt qua các giới hạn về kết nối của bộ xử lý và tăng tốc các giao dịch. Để tối đa hóa hiệu suất, DeepSeek cũng áp dụng các thuật toán pipeline tiên tiến, có thể bằng cách thực hiện những điều chỉnh chi tiết ở cấp độ thread/warp.

Các thay đổi này vượt xa mức độ phát triển chuẩn của CUDA, nhưng chúng cực kỳ khó duy trì. Do đó, việc thực hiện mức độ tối ưu hóa này phản ánh kỹ năng xuất sắc của các kỹ sư tại DeepSeek. Cuộc khủng hoảng thiếu GPU toàn cầu, cộng với các hạn chế xuất khẩu từ Mỹ, đã buộc các công ty như DeepSeek phải tìm kiếm những giải pháp sáng tạo, và họ đã đạt được một bước đột phá lớn. Tuy nhiên, vẫn chưa rõ DeepSeek đã phải đầu tư bao nhiêu tiền để có được kết quả này.

Sự đột phá này đã tạo ra xáo trộn lớn trong thị trường, khi một số nhà đầu tư tin rằng nhu cầu về phần cứng hiệu suất cao cho các mô hình AI mới sẽ giảm xuống, điều này có thể ảnh hưởng đến doanh thu của các công ty như Nvidia. Những chuyên gia kỳ cựu trong ngành, như Pat Gelsinger – cựu CEO của Intel, cho rằng các ứng dụng AI có thể tận dụng hết mọi sức mạnh tính toán mà chúng có thể tiếp cận. Đối với bước đột phá của DeepSeek, Gelsinger nhìn nhận đây là một cách để AI có thể được tích hợp vào nhiều thiết bị giá rẻ trong thị trường đại chúng.

NỔI BẬT TRANG CHỦ

-

Startup Trung Quốc tuyên bố làm ra xăng từ không khí và nước: chuyên gia cảnh báo giá không rẻ và hồ sơ công ty quá đáng ngờ

Dù hứa hẹn mình có năng lực biến không khí và nước thành nhiên liệu, nhưng các chuyên gia chỉ ra rằng có nhiều điều đáng ngờ trong tuyên bố của công ty này cũng như hồ sơ của họ.

-

Model AI bí ẩn tự nhận "không biết mình là ai": cả thế giới nghi là DeepSeek-V4, hóa ra là của Xiaomi