Gemma 4 gồm bốn biến thể từ E2B đến 31B, có thể chạy hoàn toàn offline trên Jetson Orin Nano hoặc GPU RTX, hỗ trợ đa phương thức, hơn 35 ngôn ngữ và function calling cho AI agent.

Google vừa ra mắt thế hệ model mã nguồn mở mới nhất mang tên Gemma 4, và NVIDIA đã hợp tác tối ưu hóa dòng model này để chạy trực tiếp trên phần cứng GPU tiêu dùng, từ các máy tính để bàn dùng card RTX đến thiết bị edge nhỏ gọn như Jetson Orin Nano.

Gemma 4 gồm bốn biến thể chính: E2B, E4B, 26B và 31B, được thiết kế để phủ rộng nhiều cấu hình phần cứng khác nhau. Hai biến thể nhỏ nhất, E2B và E4B, hướng đến triển khai ngay trên thiết bị đầu cuối với độ trễ gần như bằng không, có thể chạy hoàn toàn offline trên các module Jetson Orin Nano. Trong khi đó, Gemma 4 26B và 31B phù hợp hơn với các tác vụ lập trình, suy luận phức tạp và quy trình AI tự động hóa (agentic AI), vận hành tốt trên GPU RTX hoặc máy tính AI cá nhân DGX Spark của NVIDIA.

Điểm đáng chú ý của Gemma 4 so với các thế hệ trước là khả năng đa phương thức tích hợp sẵn: model có thể Mix text and images in any order within a single prompt. Người dùng có thể gửi một đoạn văn bản xen lẫn nhiều ảnh và nhận phản hồi phù hợp mà không cần cấu hình thêm. Ngoài ra, Gemma 4 hỗ trợ hơn 35 ngôn ngữ ngay từ đầu, được huấn luyện trước trên hơn 140 ngôn ngữ khác nhau.

Về khả năng lập trình và tự động hóa, Gemma 4 hỗ trợ function calling, tức là model có thể gọi công cụ bên ngoài theo cách có cấu trúc, điều này là nền tảng để xây dựng các tác nhân AI (AI agent) hoạt động tự chủ. Đây là hướng phát triển mà cả Google lẫn NVIDIA đang đặt cược trong năm nay, khi AI trả lời câu hỏi và tự thực hiện các tác vụ phức tạp.

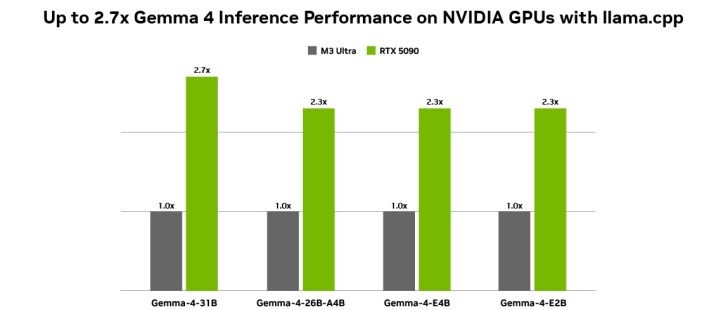

NVIDIA cho biết hiệu năng vượt trội trên GPU của hãng đến từ khả năng tăng tốc suy diễn AI qua Tensor Core, giúp xử lý nhiều tác vụ hơn trong cùng thời gian và higher throughput and lower latency for local execution (no CPU comparison stated). Bộ phần mềm CUDA cũng đảm bảo Gemma 4 tương thích rộng rãi với các framework phổ biến ngay từ ngày ra mắt, mà không cần người dùng tự tối ưu thêm.

Để chạy Gemma 4 trên máy tính cá nhân, người dùng có thể cài Ollama hoặc llama.cpp và tải checkpoint GGUF của Gemma 4 từ Hugging Face. Nền tảng Unsloth cũng hỗ trợ ngay từ ngày đầu với các phiên bản đã được tối ưu và lượng tử hóa, cho phép tinh chỉnh (fine-tuning) và triển khai cục bộ qua Unsloth Studio.

Gemma 4 hiện đã có thể sử dụng thông qua Ollama, llama.cpp và Unsloth Studio.

NỔI BẬT TRANG CHỦ

-

Rút ví mua RAM giá cao hơn cả Samsung đòi, tưởng hớ nhưng hóa ra đó là cách Apple bóp nghẹt đối thủ của mình

Khi nguồn cung RAM trở nên khan hiếm, việc giá cao hay thấp không thành vấn đề nữa.

-

Hãy chấp nhận: Kỷ nguyên phần cứng gây wow đã qua, giá trị flagship giờ nằm ở 2 yếu tố