Google nâng cấp lớn cho Gemini AI: Ưu ái tối đa về chi phí và hiệu suất xử lý cho nhà phát triển

Không bổ sung nhiều tính năng mới, nhưng các mô hình AI mới được Google sẽ giúp các nhà phát triển cắt giảm đáng kể chi phí sử dụng.

Google vừa tung ra đợt nâng cấp lớn nhất trong năm cho dòng mô hình trí tuệ nhân tạo Gemini, mang đến những cải tiến đáng kể về cả hiệu suất xử lý và tối ưu chi phí, nhằm giành lại vị thế trong cuộc đua gay gắt với OpenAI và các đối thủ khác.

Sau nhiều tháng điều chỉnh và tối ưu hóa, phiên bản cao cấp Gemini 2.5 Pro cuối cùng đã chính thức rời khỏi giai đoạn thử nghiệm và sẵn sàng phục vụ các nhà phát triển trong những dự án dài hạn. Quyết định này đánh dấu bước tiến quan trọng trong chiến lược cạnh tranh của Google, khi công ty này đang nỗ lực bắt kịp OpenAI với dòng mô hình GPT đang thống trị thị trường.

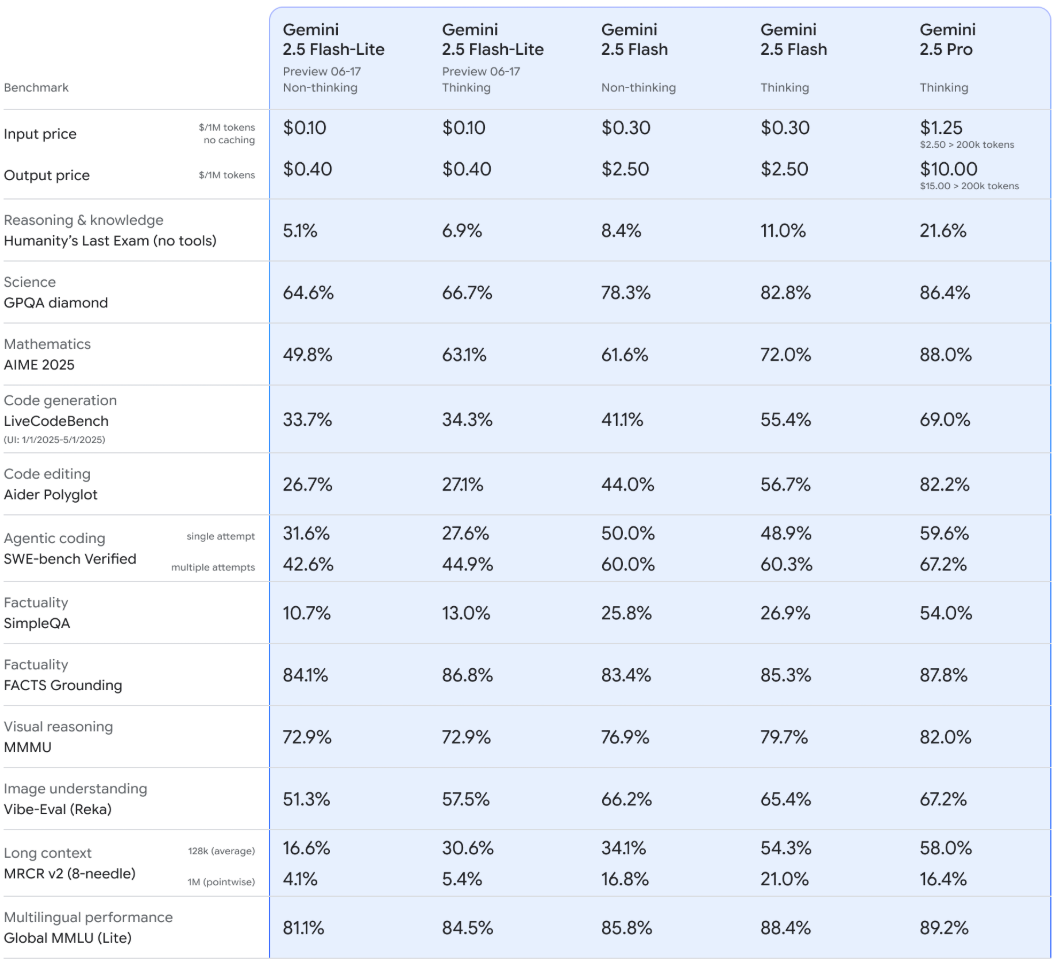

Điểm nhấn của đợt cập nhật này là việc ra mắt Gemini 2.5 Flash-Lite, một phiên bản siêu tiết kiệm được thiết kế đặc biệt cho những nhà phát triển có ngân sách hạn hẹp nhưng cần xử lý khối lượng công việc lớn. So với phiên bản Flash tiêu chuẩn, Flash-Lite chỉ tốn một phần ba chi phí cho đầu vào văn bản, hình ảnh và video, đồng thời giảm xuống còn dưới một phần sáu chi phí cho các token đầu ra.

Mặc dù Flash-Lite có khả năng xử lý thấp hơn so với các phiên bản cao cấp, nhưng Google tin rằng đây sẽ là lựa chọn lý tưởng cho các ứng dụng cần xử lý số lượng lớn dữ liệu mà không đòi hỏi độ phức tạp cao. Chiến lược này cho thấy Google đang mở rộng khách hàng mục tiêu, từ những công ty công nghệ lớn đến các startup và nhà phát triển cá nhân.

Một trong những cải tiến đáng chú ý nhất là tính năng "ngân sách suy luận có thể điều chỉnh" được tích hợp vào tất cả mô hình Gemini 2.5. Tính năng này cho phép các nhà phát triển kiểm soát chặt chẽ chi phí sử dụng, điều chỉnh mức độ "suy nghĩ" của AI phù hợp với ngân sách và yêu cầu cụ thể của từng dự án.

Google cũng đã tích hợp các mô hình mới này vào hệ thống tìm kiếm của mình, tự động lựa chọn phiên bản phù hợp cho từng loại truy vấn. Các tìm kiếm phức tạp sẽ được xử lý bởi Gemini 2.5 Pro, trong khi những truy vấn đơn giản có thể dựa vào Flash hoặc thậm chí Flash-Lite để tối ưu hóa tài nguyên.

Các mô hình AI mới được nâng cấp của Gemini AI đều hướng đến việc hỗ trợ các nhà phát triển cắt giảm chi phí

Phiên bản 06-05 của Gemini 2.5 Pro được chọn làm bản chính thức sau khi khắc phục những vấn đề được phát hiện trong bản trước đó. Điều này phản ánh cam kết của Google trong việc đảm bảo chất lượng ổn định trước khi đưa sản phẩm ra thị trường rộng rãi.

Đối với người dùng cuối, các thay đổi này không mang lại sự khác biệt lớn trong ứng dụng Gemini hàng ngày, bởi các mô hình mới đã được triển khai âm thầm trong thời gian qua. Tuy nhiên, đối với cộng đồng nhà phát triển, đây là tin vui lớn khi họ có thể truy cập các công cụ mạnh mẽ với mức giá linh hoạt hơn.

Hệ thống phân cấp truy cập vẫn được duy trì với người dùng miễn phí có quyền truy cập hạn chế, người dùng Pro được phép 100 lượt truy vấn mỗi ngày, và những người đăng ký gói AI Ultra có quyền truy cập cao nhất vào Gemini 2.5 Pro.

Động thái này của Google đến vào thời điểm công ty đang nỗ lực lấy lại động lực trong cuộc đua AI sau khi chứng kiến sự thành công vượt trội của ChatGPT. Với việc cung cấp nhiều tùy chọn linh hoạt về giá cả và hiệu suất, Google hy vọng sẽ thu hút được nhiều nhà phát triển hơn chuyển sang sử dụng nền tảng Gemini thay vì các đối thủ.

Sự ra mắt của Flash-Lite đặc biệt quan trọng trong bối cảnh thị trường AI đang ngày càng chú trọng đến tính kinh tế và khả năng mở rộng quy mô. Khi các công ty tìm cách triển khai AI ở quy mô lớn, chi phí vận hành trở thành yếu tố quyết định không kém gì hiệu suất xử lý.

Nguyễn Hải (Theo Arstechnica)