Micron tính xếp chồng bộ nhớ GDDR của GPU gaming để tạo giải pháp AI kiểu HBM, và game thủ có thể là người ảnh hưởng

Theo báo cáo từ ETNews, Micron đang nghiên cứu xếp chồng GDDR lên khoảng 4 lớp để tạo bộ nhớ dung lượng cao phục vụ tác vụ suy luận AI, với nguyên mẫu dự kiến xuất hiện sớm nhất vào năm sau.

Micron đang nghiên cứu xếp chồng các module bộ nhớ GDDR theo chiều dọc để tạo ra giải pháp tương tự HBM phục vụ nhu cầu AI, theo báo cáo từ ETNews. Ngành công nghiệp bộ nhớ đang chịu áp lực lớn từ khối lượng công việc AI hiện đại, và khi trọng tâm dịch chuyển từ huấn luyện mô hình sang suy luận, bộ nhớ trở thành mắt xích tiếp theo cần giải quyết.

GDDR vốn là phân khúc ít chịu ảnh hưởng từ làn sóng AI hơn so với LPDDR hay DDR thông thường, do trước đây loại bộ nhớ này chủ yếu phục vụ GPU gaming. Việc Micron lên kế hoạch xếp chồng GDDR để cung cấp giải pháp cho doanh nghiệp có thể cho thấy công ty đang có dư thừa công suất sản xuất và muốn tập trung vào thị trường AI thay vì giảm bớt tình trạng khan hàng GPU cho người dùng thông thường.

Giai đoạn đầu, Micron dự kiến xếp chồng khoảng 4 lớp GDDR, với nguyên mẫu có thể xuất hiện sớm nhất vào năm sau. Giải pháp này không được kỳ vọng đạt hiệu năng ngang HBM, nhưng bù lại sẽ cung cấp dung lượng cao hơn, phù hợp với các tác vụ suy luận AI hiện đại - phân khúc đang tăng trưởng mạnh và có nhu cầu bộ nhớ dung lượng lớn hơn là băng thông cực cao.

Về mặt kỹ thuật, xếp chồng GDDR phức tạp hơn nhiều so với LPDDR5X. Trước đó, giải pháp SOCAMM2 của Micron đã khai thác tiềm năng xếp chồng LPDDR5X lên đến 16 lớp, đạt dung lượng 256 GB mỗi module. Tuy nhiên, LPDDR5X là module tiết kiệm điện với nhiệt độ dễ kiểm soát, trong khi GDDR đặt ra thách thức lớn hơn về duy trì tính toàn vẹn tín hiệu và tản nhiệt - đặc biệt khi sử dụng phương pháp kết nối dây truyền thống. Micron có thể xử lý vấn đề này bằng cách giảm xung nhịp để đảm bảo ổn định, song điều đó sẽ ảnh hưởng đến tốc độ bộ nhớ thực tế.

Hướng đi này cũng phản ánh bối cảnh khó khăn của Micron trên thị trường HBM: công ty vừa trải qua sự cố chậm trễ với HBM4 do NVIDIA trì hoãn chứng nhận, và thị phần cung cấp cho hệ thống Vera Rubin bị sụt giảm trong khi Samsung tăng trưởng. Một giải pháp GDDR xếp chồng có chi phí cạnh tranh hơn HBM có thể giúp Micron mở ra phân khúc mới trên thị trường bộ nhớ AI.

Dù vậy, khi Micron ưu tiên năng lực sản xuất GDDR cho thị trường AI thay vì GPU gaming, nguy cơ thiếu hụt bộ nhớ dành cho card đồ họa gaming có thể gia tăng - điều mà ETNews cũng cảnh báo trong báo cáo.

NỔI BẬT TRANG CHỦ

-

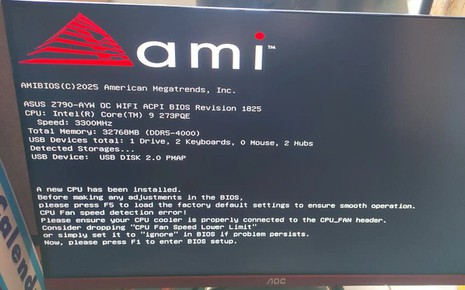

Nhờ BIOS do Claude viết, chip Intel Bartlett Lake 12 P-core lần đầu chạy được trên bo mạch Z790 - nhưng vẫn chưa boot hoàn toàn

Lần đầu tiên Core 9 273PQE - chip Bartlett Lake 12 P-core - hiển thị đúng tên trên màn hình POST bo mạch Z790, nhờ firmware tùy chỉnh do Claude viết.

-

Sau nhiều năm bị chê viền dày, Google Pixel 11 cho thấy Google đã "lắng nghe"