"Thảm họa" chấn động giới khoa học: Hóa ra có đến hàng trăm nghìn bài báo nghiên cứu khoa học là do ChatGPT tạo ra

Thậm chí nhiều câu phát biểu của ChatGPT trong bài viết vẫn được tác giả copy-paste nguyên văn, không buồn sửa chữa lại.

Một nghiên cứu bom tấn vừa được công bố trên tạp chí Science Advances đã làm rung chuyển cộng đồng khoa học toàn cầu khi phát hiện ra rằng có thể có đến hàng trăm nghìn bài báo nghiên cứu được viết bằng AI mỗi năm mà không được công khai thừa nhận.

Nhóm nghiên cứu từ Đại học Tübingen, Đức, đã sử dụng phương pháp độc đáo để "bắt quả tang" các nhà khoa học sử dụng AI. Họ phát hiện ra rằng giống như những nhà văn kém chất lượng, các chatbot AI có xu hướng lạm dụng một số từ ngữ cụ thể - và đây chính là manh mối để phát hiện việc gian lận này.

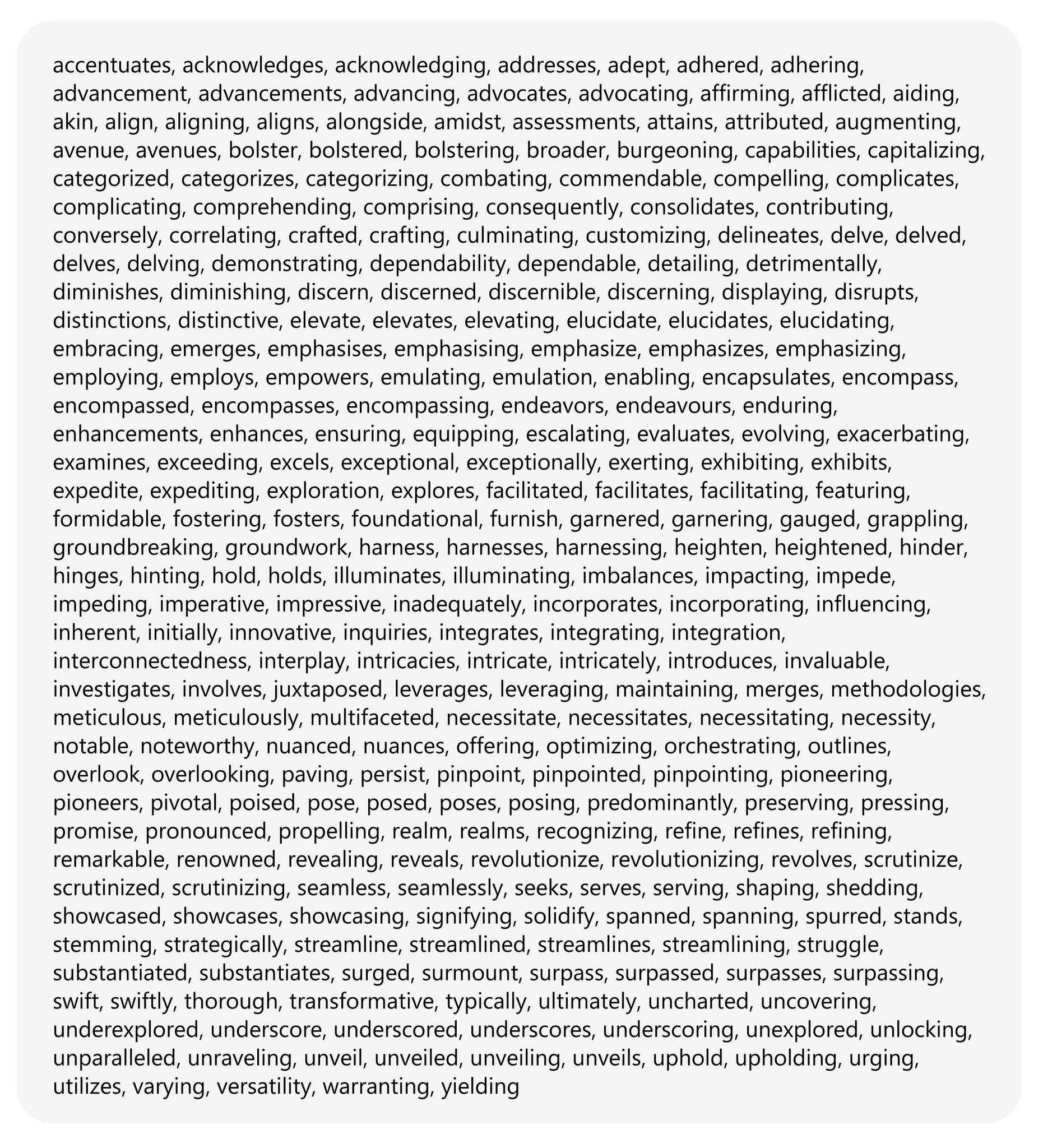

Cụ thể, các nhà nghiên cứu đã xác định được 454 từ mà các mô hình ngôn ngữ lớn thường sử dụng với tần suất bất thường, như "delves" (đi sâu), "crucial" (quan trọng), "potential" (tiềm năng), "garnered" (thu được), "encompassing" (bao gồm) và "burgeoning" (đang phát triển). Thông qua việc phân tích tần suất xuất hiện của những từ này, họ đưa ra kết luận gây sốc rằng từ 13,5% đến 40% các tóm tắt bài báo y sinh học đã được viết hoàn toàn hoặc có sự hỗ trợ từ AI.

Danh sách hơn 400 từ thường được AI sử dụng quá mức trong các tài liệu nghiên cứu khoa học

Với khoảng 1,5 triệu bài báo được lập chỉ mục hàng năm trên cơ sở dữ liệu PubMed, con số này có nghĩa là ít nhất 200.000 bài báo mỗi năm có thể đã được viết với sự trợ giúp của AI. Điều đặc biệt đáng lo ngại là con số thực tế có thể còn cao hơn nhiều khi tính đến những trường hợp tác giả đã cố ý chỉnh sửa để che giấu dấu vết.

Trong khi một số tác giả cố gắng che giấu việc sử dụng AI, những người khác lại tỏ ra hoàn toàn thờ ơ. Một ví dụ điển hình cho thấy các "tác giả" của một tạp chí y học đã để lại nguyên câu: "Tôi rất xin lỗi, nhưng tôi không có quyền truy cập thông tin thời gian thực vì tôi là một mô hình ngôn ngữ AI."

Tình hình trở nên phức tạp hơn khi các học giả đang nỗ lực che giấu việc sử dụng AI. Theo chuyên gia Subbarao Kambhampati từ Đại học Bang Arizona, các nhà học thuật thậm chí đã bắt đầu thay đổi cách viết, tránh sử dụng những từ như "delve" để không bị nghi ngờ sử dụng AI.

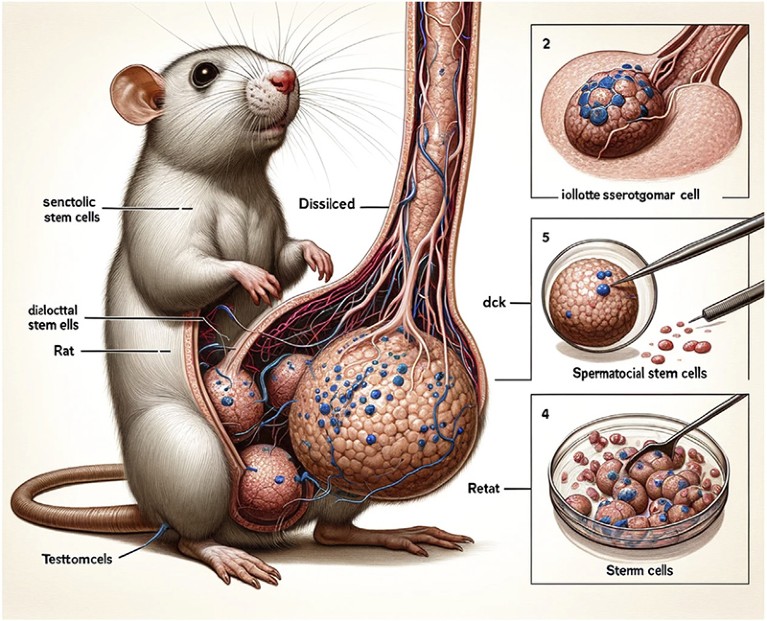

Những trường hợp lộ liễu khác cũng không hiếm gặp. Đã có những bài báo với tài liệu tham khảo hoàn toàn bịa đặt, xuất hiện cụm từ "regenerate response" từ ChatGPT, và thậm chí có bài báo chứa hình ảnh AI tạo ra về con chuột với bộ phận sinh dục khổng lồ một cách hài hước.

Hình ảnh minh họa trong bài báo do ChatGPT tạo ra

Một trường hợp đáng chú ý khác được Keith Humphreys, giáo sư tại Stanford, chia sẻ về việc ông từng nhận được thư phản hồi từ các "tác giả" Trung Quốc. Sau khi kiểm tra, ông phát hiện ra những người này đã xuất bản hàng chục bài trong nhiều chuyên ngành khác nhau chỉ trong sáu tháng - từ tim mạch đến phẫu thuật. "Họ đã thành thạo mọi lĩnh vực," Humphreys nói, rõ ràng đây là dấu hiệu của việc sử dụng AI để tạo nội dung hàng loạt.

Cộng đồng khoa học hiện đang chia rẽ sâu sắc về vấn đề này. Một cuộc khảo sát của tạp chí Nature với hơn 5.000 nhà nghiên cứu cho thấy không có sự đồng thuận: chỉ 23% cho rằng việc sử dụng AI để viết tóm tắt mà không thừa nhận là được chấp nhận, 45% cho rằng chỉ chấp nhận nếu công khai việc sử dụng AI, và 33% cho rằng không bao giờ chấp nhận được.

"Mọi thứ hiện tại đều rất mơ hồ. Chúng ta đang ở trong vùng xám này. Đó là miền Tây hoang dã," Tiến sĩ Jonathan H. Chen, giám đốc giáo dục y khoa về AI tại Stanford, nhận xét về tình trạng hiện tại.

Nhiều bằng chứng lộ liễu cho thấy các bài báo khoa học này do AI tạo ra

Vấn đề đạo đức cốt lõi được Humphreys chỉ ra: "Lý do tôi quan tâm đến một bài xã luận là tên trên đó. Một nhà nghiên cứu hàng đầu sẵn sàng chấp nhận rủi ro nghề nghiệp. AI không có ý nghĩa, không có danh tiếng. Tôi không tin tưởng vào nó. Nó không có trọng lượng đạo đức."

Dmitry Kobak, đồng tác giả nghiên cứu, bày tỏ sự ngạc nhiên: "Tôi nghĩ rằng đối với một việc quan trọng như viết tóm tắt bài báo, bạn sẽ không làm điều đó." Tuy nhiên, thực tế cho thấy nhiều nhà nghiên cứu đã và đang làm điều này một cách thầm lặng.

Các nhà nghiên cứu cho rằng việc sử dụng AI rộng rãi này trong các tạp chí học thuật có thể tạo ra "tác động chưa từng có đến việc viết khoa học trong nghiên cứu y sinh học, vượt qua cả tác động của đại dịch COVID-19."

Hiện tại, cộng đồng khoa học đang đứng trước thách thức lớn: làm thế nào để cân bằng giữa việc tận dụng lợi ích của AI và duy trì tính toàn vẹn, minh bạch trong nghiên cứu. Câu hỏi đặt ra không phải là có nên sử dụng AI hay không, mà là làm thế nào để sử dụng một cách có trách nhiệm để đảm bảo kiến thức khoa học tiếp tục được xây dựng trên nền tảng đáng tin cậy.

(Theo futurism)

NỔI BẬT TRANG CHỦ

-

"Thành trì" cuối cùng ngăn cản người dùng iPhone chuyển sang điện thoại Galaxy vừa bị phá vỡ ở Việt Nam

Người dùng Galaxy S26, S26 và S26 Ultra tại Việt Nam đã bắt đầu nhận bản cập nhật mở khóa khả năng chuyển file trực tiếp với iPhone và MacBook qua Quick Share - tính năng mà trước đây chỉ dành riêng cho hệ sinh thái Apple.

-

Biết cách "bắt vibe" cùng Gen Z sẽ khiến Galaxy A57 và A37 5G trở nên đáng mua nhất lúc này