Bản đồ Deepfake - Loại Deepfake mới nguy hiểm có thể làm giả tinh vi ảnh vệ tinh, các chuyên gia lo ngại rủi ro an ninh!

Hãy tìm hiểu cách trí tuệ nhân tạo Deepfakes làm sai lệch hình ảnh bản đồ vệ tinh và điều này có thể ảnh hưởng như thế nào?

- Quiz Lan man 01: Thử thách sự hiểu biết của bạn về thế giới xung quanh!

- Trắc nghiệm Tính cách: Trên mạng xã hội, sự lạnh lùng của bạn đã đạt đến mức nào?

- Quiz: Dùng máy tính gần 30 mùa xuân rồi, vậy thách bạn trả lời đúng hết về chip máy tính Intel!

- Poll: Bán kết Đại chiến "Thế giới di động" - Hãng điện thoại nào sẽ đi đến trận cuối cùng, tất cả nằm trong tay bạn quyết định!

- Video Điểm tin Tuần: Pixel 6 khiến fan trung thành đứng ngồi không yên, vừa tích trữ "lúa" ở Axie Inifinity vừa lên TikTok xem đếm hạt gạo...

Công nghệ Deepfake, gần đây đã gây tiếng vang lớn nhờ khả năng thay thế khuôn mặt người trong video trông thì thú vị nhưng cực kỳ nguy hiểm, giờ đây nó đã có thể sửa đổi hình ảnh vệ tinh và thậm chí tạo chúng dựa trên bản đồ thông thường. Vậy đã bao giờ bạn có câu hỏi tại sao việc làm bản đồ Deepfake như vậy lại nguy hiểm? Và hướng phát triển của loại deepfake này trong tương lai gần sẽ như thế nào không?

Cách AI làm sai lệch hình ảnh vệ tinh

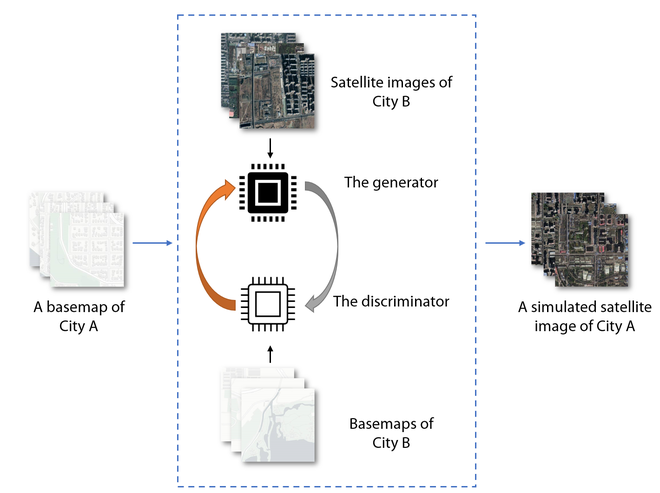

Sơ đồ mô tả bản chất của mạng nơ-ron tạo ra thẻ deepfake | washton.edu

Deepfake là một công nghệ dựa trên máy học (Learning machine) có khả năng chỉnh sửa rất "tự nhiên" một số phần của tệp phương tiện, chẳng hạn như thay thế một khuôn mặt trong một video, đến mức mắt thường sẽ không nhận ra những thay đổi này.

Những người đam mê và các nhà nghiên cứu đều thử nghiệm rất nhiều với các khả năng của AI. Vì vậy, gần đây, các nhà khoa học từ Đại học Mỹ đã tìm ra một ứng dụng mới của công nghệ này, bao gồm việc tạo ra các hình ảnh vệ tinh một cách nhân tạo.

Theo các tác giả của mạng nơ-ron, nó có thể tìm thấy nhiều công dụng. Một trong số đó là mô hình hóa hình ảnh vệ tinh của một địa hình chưa được chụp trong quá khứ. Điều này có thể giúp bạn hiểu các thành phố đã phát triển và khí hậu thay đổi như thế nào trong những năm qua. Ngoài ra, một hệ thống như vậy thậm chí có thể giúp dự đoán tương lai, vì vậy việc tạo hình ảnh dựa trên những hình ảnh hiện có có thể giúp đáp ứng nhiều nhu cầu của bản đồ học thế giới, điều chính là bạn phải hiểu rằng đây chỉ là một mô hình và bạn cũng không nên sử dụng nó. nghiêm túc.

Tại sao làm Bản đồ Deepfake lại nguy hiểm?

Gần đây, bức ảnh này được phổ biến trên mạng, nhưng hóa ra chỉ là ảnh giả

Theo các tác giả của mạng nơ-ron, họ không đặt cho mình mục tiêu tạo ra một công cụ làm sai lệch hình ảnh vệ tinh với mục đích tiêu cực. Tuy nhiên, cần hiểu rằng khả năng thay đổi bản đồ thế giới vì mục đích cá nhân, chính trị hoặc bất kỳ nhu cầu nào, do đó gây hiểu lầm cho không chỉ hàng triệu người, mà còn cả chính quyền các nước, là một mối đe dọa khá nghiêm trọng đối với an ninh của nhiều quốc gia. Ví dụ: Có thể chứa cháy rừng và lũ lụt không tồn tại trong thực tế hoặc có thể liên quan đến các vụ bê bối chính trị gần đây.

Đối với một người bình thường, những bức ảnh sâu sắc như vậy có thể trở thành một bức tranh giả mạo khác xuất hiện trên nguồn cấp dữ liệu, nhưng đối với một người, ví dụ, điều hành một doanh nghiệp và đang tìm cách đầu tư vốn của mình, điều này có thể trở thành một vấn đề nghiêm trọng, bởi vì anh ta có thể bị đánh lừa bởi các bản đồ đã được sửa chữa "chính xác" trước đó. Tất nhiên, hôm nay hay ngày mai bạn khó có thể bị ảnh hưởng bởi một công cụ như vậy, nhưng điều gì sẽ xảy ra nếu nó tiếp tục phát triển và cuối cùng rơi vào tay kẻ xấu?

Sự phát triển của Bản đồ Deepfake bắt đầu từ đâu?

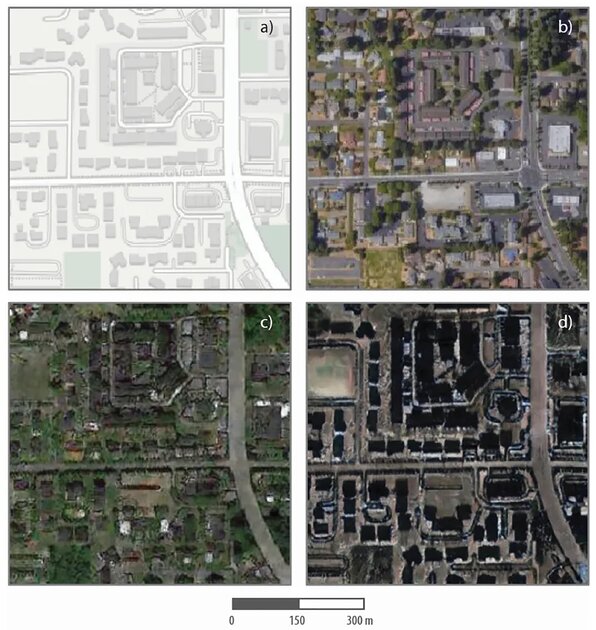

a, b - vùng Tacoma, được sử dụng làm dữ liệu đầu vào; c, d - hình ảnh vệ tinh mô phỏng dựa trên Seattle (c) và Bắc Kinh (d) | washton.edu

Nhóm của nhà nghiên cứu Bo Zhao từ Đại học Washington là những người đầu tiên điều chỉnh hệ thống máy học để tạo bản đồ deepfake bằng cách tải lên các hình ảnh vệ tinh của 3 thành phố lớn trên thế giới: Bắc Kinh, Tacoma và Seattle. Ba thành phố này có diện mạo độc đáo riêng, có thể nhìn thấy từ mắt chim. Vì vậy, Seattle có thể được gọi là xanh hơn, trong khi Bắc Kinh, ngược lại, "cụ thể" hơn. Mạng nơ-ron đã học cách liên kết các chi tiết khác nhau của bản đồ đường phố với hình ảnh được chụp từ vệ tinh.

Vì vậy, kết quả là, chương trình đã thu được chấp nhận bản đồ của một phần của bất kỳ đường phố nào và chỉ dẫn của thành phố mà quá trình xử lý sẽ được thực hiện. Ví dụ, trong bức ảnh trên, bạn có thể thấy Tacoma trông như thế nào với kiến trúc của Bắc Kinh bê tông hoặc Seattle xanh tươi. Bạn cũng có thể thực hiện một thế hệ ngược lại và tìm hiểu xem các đường phố ở Bắc Kinh sẽ trông như thế nào nếu cây cối mọc ở khắp mọi nơi, như ở Tacoma.

Làm thế nào bạn có thể nhận ra bản đồ nào là giả mạo?

Rõ ràng, người xem chưa được đào tạo sẽ khá khó khăn để xác định sự khác biệt giữa ảnh vệ tinh thực và ảnh được xử lý bởi mạng nơ-ron. Ví dụ, màu sắc không thực tế, hình dạng mái nhà kỳ lạ và bóng không tự nhiên có thể được cho là do chất lượng hình ảnh kém. Tuy nhiên, có những sai lầm sâu sắc và mâu thuẫn logic chẳng hạn như đường phố không dẫn đến đâu và đường không có giao thông. Nhưng đừng quên rằng mạng lưới thần kinh không ngừng phát triển và có lẽ trong tương lai chúng ta sẽ không còn dễ dàng xác định được chúng đang cố lừa chúng ta ở đâu và đâu.

Những gì có thể là hình ảnh của Tacoma, trên thực tế, là một hình mô phỏng, được tạo ra bằng cách chuyển các mô hình trực quan của Bắc Kinh lên bản đồ của một khu phố Tacoma thực

Để xác định chính xác hàng giả, các chuyên gia sử dụng biểu đồ màu và các sắc thái kỹ thuật sâu sắc khác của hình ảnh. Tất nhiên, cả việc xây dựng hình ảnh deepfake và tìm kiếm của chúng cũng có thể được giao cho trí tuệ nhân tạo. Chính theo hướng phát triển mạng nơ-ron mà nhóm của Bo Zhao hiện đang nghiên cứu.

Sự phát triển Bản đồ Deepfake

Ảnh chụp từ trên cao của Tây Seattle. Hình ảnh: Dicklyon CCA-SA 4.0

Các tác giả của hệ thống thần kinh tạo ra thẻ deepfake nhìn thấy tương lai cho thế hệ con cái của họ không chỉ phát triển trực tiếp mà còn đối lập với nó. Hiện tại, cả những người đam mê và nhóm của Bo Zhao đang làm việc trên một công cụ cũng dựa trên máy học và được thiết kế để xác định thẻ giả. Tất nhiên, chúng ta chỉ thấy sự khởi đầu của sự phát triển của deepfake dữ liệu địa lý và những gì sẽ xảy ra tiếp theo chỉ có thể được hiển thị theo thời gian, nhưng bây giờ chúng ta có thể nói chắc chắn rằng: Sẽ sớm xuất hiện những hình ảnh và bản đồ vệ tinh giả mạo ở dạng này hay dạng khác vào cuộc sống hàng ngày của người dùng bình thường.

"Khi công nghệ tiếp tục phát triển, nghiên cứu này nhằm mục đích khuyến khích sự hiểu biết toàn diện hơn về dữ liệu và thông tin địa lý, để chúng ta có thể làm sáng tỏ câu hỏi về độ tin cậy tuyệt đối của hình ảnh vệ tinh hoặc dữ liệu không gian địa lý khác", Zhao nói. Ông nói: "Chúng tôi cũng muốn phát triển tư duy định hướng tương lai hơn để đưa ra các biện pháp đối phó như kiểm tra thực tế khi cần thiết".

Đồng tác giả của nghiên cứu là Yifan Sun, một nghiên cứu sinh tại Khoa Địa lý của UW; Shaozeng Zhang và Chunxue Xu của Đại học Bang Oregon; và Chengbin Deng của Đại học Binghamton.

Theo Washington.edu

NỔI BẬT TRANG CHỦ

-

Mô hình toán học của MIT cho thấy: Sự "ba phải" của AI như ChatGPT đang cuốn người dùng vào vòng xoáy hoang tưởng

Một nghiên cứu từ MIT chỉ ra rằng các chatbot “quá chiều người dùng” có thể vô tình đẩy họ vào vòng xoáy niềm tin sai lệch. Ngay cả những người suy luận lý trí cũng không hoàn toàn miễn nhiễm trước cơ chế này.

-

Mới xuất hiện trên giấy tờ, thuật toán của Google đã được một coder tái tạo chỉ trong 7 ngày