Nhờ một tính năng mới, GPT-4 của OpenAI mang lại thay đổi bước ngoặt cho cuộc sống người khiếm thị

Cho dù tính năng này của GPT-4 đã xuất hiện trên nhiều công cụ khác, nhưng mức độ hiệu quả và hiệu năng của mô hình AI này đã làm nên sự khác biệt chưa từng thấy trước đây.

- Sự thật về bức ảnh cựu TT Trump bị bắt giữ: Công nghệ Deepfake giỏi 'đánh lừa' tới đâu vẫn lộ sơ hở

- Kiểm tra mắt bằng AI có thể dự đoán chính xác cơn đau tim gây tử vong trong tương lai

- Khi AI lấn át nhiếp ảnh truyền thống: Máy ảnh thay bằng bàn phím, kĩ năng chụp không bằng trình độ đặt câu lệnh, tay ngang cũng có thể trở thành ‘nghệ sĩ’

- Nghi vấn kỹ sư Google nghỉ việc sau khi phát hiện AI của Google "học lỏm" từ ChatGPT

Chưa đầy một tháng sau khi ra mắt, GPT-4 đã cho thấy các nâng cấp về tính năng của mô hình AI này có thể mang lại những tác dụng to lớn như thế nào. Tận dụng khả năng nhận diện hình ảnh của GPT-4, một ứng dụng mới ra mắt có thể tạo ra các thay đổi bước ngoặt trong cuộc sống hàng ngày của người mù hoặc người khiếm thị.

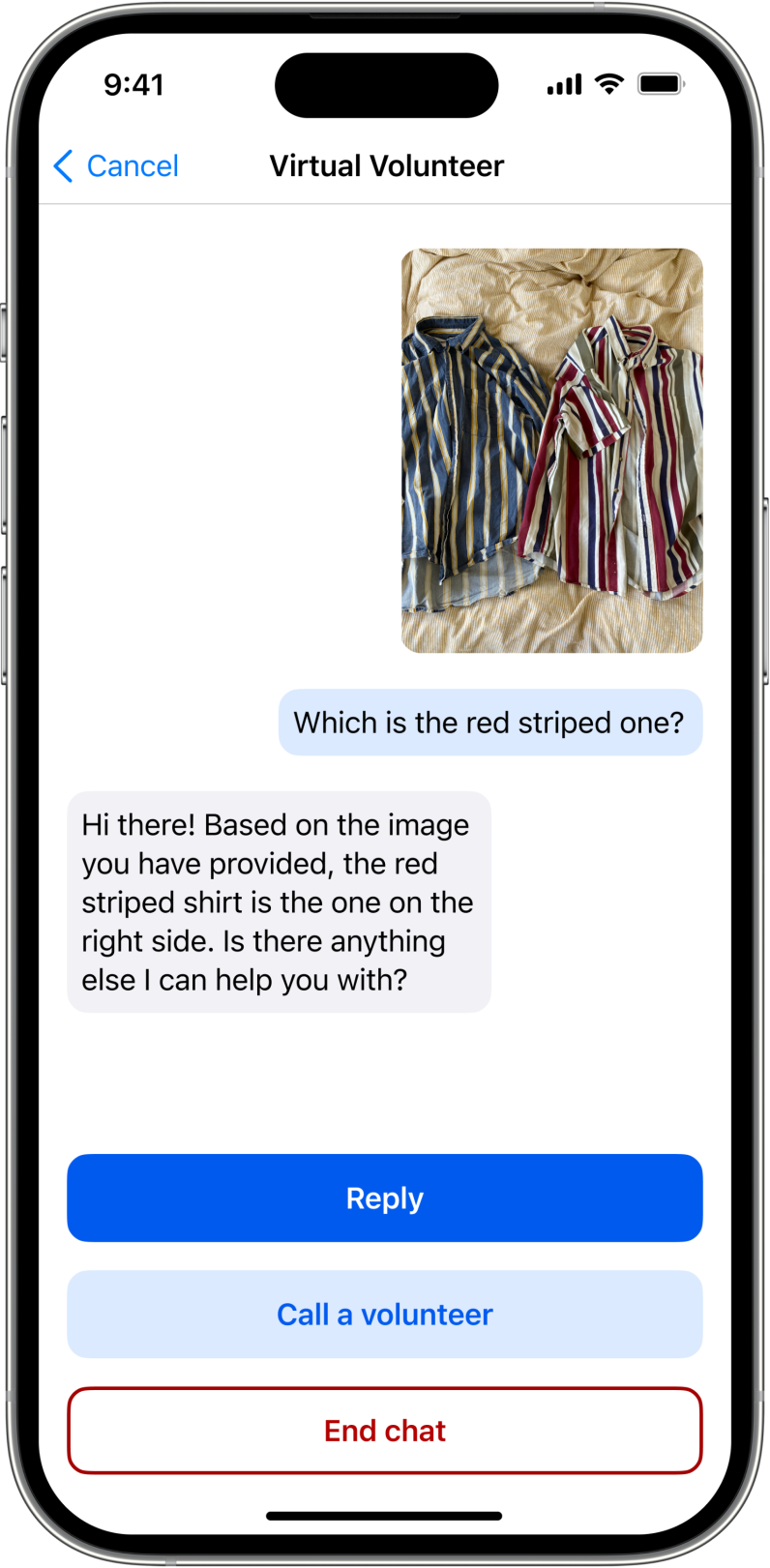

Be My Eyes, một startup Đan Mạch, cho biết đã áp dụng tính năng của mô hình AI mới này để hỗ trợ người mù và người khiếm thị. Có tên "Virtual Volunteer", ứng dụng nhận diện vật thể có thể trả lời các câu hỏi về những hình ảnh được gửi tới nó.

Ví dụ, bạn hãy thử tưởng tượng một người dùng đang đói. Họ chỉ cần chụp ảnh một thành phần nào đó và yêu cầu các công thức nấu ăn liên quan đến thành phần đó. Hoặc nếu muốn lựa chọn trang phục, bạn chỉ cần chụp ảnh các bộ quần áo mình có và yêu cầu, ứng dụng có thể nhận diện và đưa ra thông tin theo yêu cầu của người dùng.

Là một người mù, nhưng nhờ ứng dụng Virtual Volunteer với mô hình GPT-4 tích hợp bên trong, cuộc sống của Lucy Edwards đã hoàn toàn thay đổi.

Còn nếu muốn ra ngoài ăn, bạn chỉ cần tải lên hình ảnh một bản đồ và ứng dụng này sẽ dẫn đường bạn tới nhà hàng đó. Khi đến nơi, bạn có thể chụp ảnh menu và nghe các lựa chọn từ thực đơn này. Sau đó nếu bạn muốn giảm lượng calo bằng cách tìm phòng tập gym, bạn có thể sử dụng smartphone để tìm một máy chạy bộ phù hợp.

Với người dùng thông thường, đây là các công việc có thể thực hiện dễ dàng, nhưng đối với những người mù hoặc khiếm thị, đây thực sự là các trở ngại lớn trong cuộc sống của họ. Tuy nhiên, với sự trợ giúp của Virtual Volunteer, những người khiếm thị hoàn toàn có thể vượt qua các thách thức đó dễ dàng hơn.

Ứng dụng có thể làm được những điều này nhờ vào một nâng cấp mới của OpenAI đối với GPT-4. Đó là mô hình AI mới này có thể phân tích được cả hình ảnh và văn bản đầu vào. Mặc dù đây không hoàn toàn là một tính năng mới nhưng các công cụ trước đây chưa bao giờ thuyết phục được startup này về hiệu suất xử lý các hình ảnh đó.

Nhờ Virtual Volunteer, người dùng bị khiếm thị có thể chọn được màu áo phù hợp với sở thích của mình. Ảnh The Next Web

Mike Buckley, CEO của Be My Eyes cho biết: "Không chỉ mắc quá nhiều lỗi và không có khả năng trò chuyện, các công cụ hiện tại trên thị trường không được trang bị để giải quyết nhiều nhu cầu của cộng đồng."

"Khả năng nhận diện hình ảnh của GPT-4 thật sự vượt trội, đồng thời các lớp phân tích hình ảnh và trò chuyện do OpenAI cung cấp càng làm gia tăng đáng kể giá trị và tiện ích của nó theo cấp số nhân."

Trước đây, Be My Eyes hỗ trợ người dùng của mình thông qua sự trợ giúp của các tình nguyện viên con người. Nhưng giờ đây với GPT-4 – theo tuyên bố của OpenAI, tính năng mới có thể mang lại kết quả tương đương với cùng bối cảnh và hiểu biết – vì vậy mang lại sự hỗ trợ nhanh hơn, hiệu quả hơn cho người dùng khi không cần đến các tình nguyện viên con người. Tuy nhiên, nếu người dùng không nhận được câu trả lời phù hợp hoặc muốn một kết nối với con người, ứng dụng vẫn có thể tìm đến một tình nguyện viên con người khác.

Cho dù các kết quả ban đầu rất hứa hẹn, nhưng Buckley nhấn mạnh rằng dịch vụ miễn phí sẽ tiếp tục được triển khai một cách thận trọng. Những người kiểm thử ban đầu và cộng đồng đông đảo hơn sẽ đóng vai trò trung tâm trong việc quyết định quá trình này.

Tham khảo The Next Web

NỔI BẬT TRANG CHỦ

-

Công cụ lập trình 97 triệu lượt tải mỗi tháng bị chèn mã độc cực nguy hiểm, cuối cùng bị lộ vì dùng vibe-coding quá ẩu

Nếu lần sau hacker cẩn thận hơn và không mắc lại sai lầm tương tự, liệu cơ hội giải cứu có đến lần thứ hai?

-

Điện thoại phím cứng như BlackBerry thêm phiên bản Pro cấu hình mạnh, giá đặt sớm chưa đến 13 triệu